ChatGPT estime l’âge de ses utilisateurs pour plus ou moins lacher la bride

What could go wrong?

L’entreprise de Sam Altman annonce la mise en place de plusieurs barrières pour les mineurs. Des protections supplémentaires… avant de lâcher la bride à son chatbot sur ce que les adultes peuvent générer ? C’est ce qu’avait laissé entendre Sam Altman, affaire à suivre donc.

OpenAI a annoncé ce mardi la mise en place de son système interne de prédication d’âge sur ChatGPT ainsi qu’un système de vérification d’âge géré par une entreprise tierce en deuxième option. Ce double système doit permettre de séparer les utilisations de son chatbot par les adolescents et par les adultes.

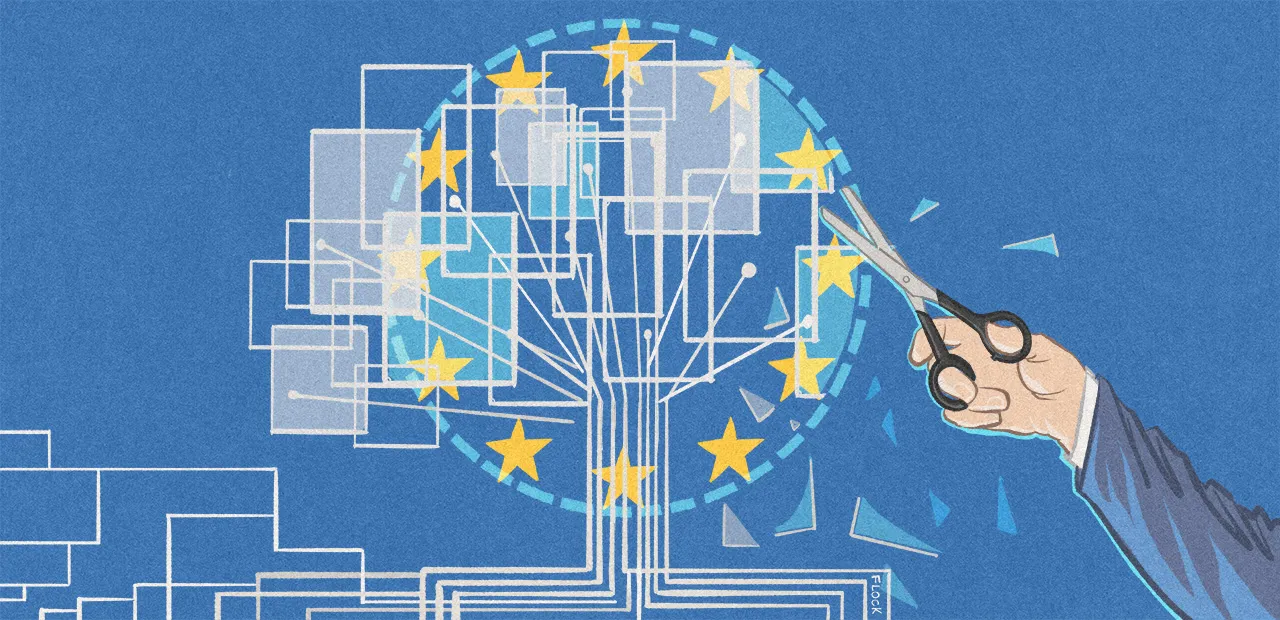

Sam Altman avait déjà sorti que son chatbot pourrait être plus érotique à l’occasion de cette séparation, mais OpenAI précise que les filtres de ChatGPT seront différents aussi pour d’autres sujets comme la violence graphique ou gore et les comportements malsains. Le déploiement est mondial, mais la société précise que, « dans l’UE, la prédiction de l’âge sera mise en place dans les prochaines semaines afin de tenir compte des exigences régionales ».

Deux solutions possibles pour franchir la barrière d’âge

Pour permettre d’accéder à son chatbot avec des restrictions beaucoup plus faibles, OpenAI propose plusieurs solutions censées filtrer les moins de 18 ans. Si les adolescents déclarent être âgés de moins de 18 ans lors de leur inscription, l’entreprise active des filtres de protection « visant à réduire leur exposition à des contenus sensibles ou potentiellement préjudiciables ».

Mais si l’utilisateur ne donne pas explicitement son âge, OpenAI utilise deux systèmes pour filtrer les mineurs. La première est un système interne de « prédiction d’âge ». Ici pas de scan de carte d’identité. OpenAI va utiliser toutes les données qu’elle collecte sur l’utilisateur pour prédire s’il a ou non plus de 18 ans. « Il examine différents signaux liés à votre compte. Par exemple, il peut examiner les sujets généraux dont vous parlez ou les moments de la journée où vous utilisez ChatGPT », affirme l’entreprise dans sa page d’aide à ce sujet. Si l’entreprise donne ces exemples, elle ne dévoile pas tous les paramètres qu’elle prend en compte pour prédire l’âge de l’utilisateur.

« Aucun système n’est parfait. Il peut parfois y avoir des erreurs », explique OpenAI dans un moment d’humilité rare dans le monde de l’IA. Elle explique que « si vous avez 18 ans ou plus et que vous avez été classé par erreur dans la catégorie des moins de 18 ans, vous pouvez vérifier votre âge ». Pour ça, l’entreprise utilise le système de vérification d’un tiers nommé Persona.

Pour cette vérification, Persona pourra, en fonction du pays où l’utilisateur se trouve, utiliser soit un selfie live soit une pièce d’identité qu’il faudra uploader. « Persona vérifie votre date de naissance et s’assure que votre selfie correspond à la photo de votre pièce d’identité », explique OpenAI, qui ajoute que « les pièces d’identité acceptées varient selon les pays ». Au passage, elle précise que Persona doit supprimer les photos des pièces d’identité et les selfies sept jours après la vérification. Le tiers envoie la date de naissance de l’utilisateur ou la prédiction d’âge. L’entreprise de Sam Altman assure conserver « ces informations en toute sécurité et les [utiliser] uniquement conformément à la politique de confidentialité d’OpenAI ».

Au passage, on peut remarquer qu’OpenAI n’a pas choisi de s’appuyer sur l’outil de scan d’iris de World ID, l’autre entreprise de Sam Altman.

Des filtres différents sur des sujets sensibles selon l’âge de l’utilisateur

À partir du moment où l’utilisateur est enregistré comme ayant plus de 18 ans par OpenAI, ChatGPT aura beaucoup moins de garde-fous.

Si l’utilisateur est détecté comme ayant moins de 18 ans, ChatGPT « applique automatiquement des protections supplémentaires conçues pour réduire l’exposition à des contenus sensibles, telles que la violence graphique ou gore, les défis viraux pouvant encourager des comportements risqués ou dangereux, les jeux de rôle à caractère sexuel, romantique ou violent, les contenus promouvant des normes de beauté extrêmes, des régimes alimentaires malsains ou du body shaming ».

Le risque est aussi que ça laisse plus de possibilités à OpenAI pour, ensuite, lâcher les vannes pour ses utilisateurs adultes et ainsi rejoindre Grok et xAI dans la génération de contenus sans réelles limites éthiques.

Rappelons qu’avec beaucoup moins de limites que ses concurrents, l’IA d’Elon Musk a généré des textes antisémites et négationnistes, des deepfakes dénudant des femmes et qu’il alimente le climatoscepticisme. La vague d’indignation mondiale suite aux deepfakes de Grok diffusés sur X ne semble pas avoir d’influence sur la levée des barrières décidée par les majors états-uniennes de l’IA.