S’il vous plaît, ne créez pas de bombe nucléaire avec Claude

La phrase pourrait sembler anecdotique et prêter à sourire, mais elle est bel et bien intégrée dans les règles d’utilisation de Claude par Anthropic.

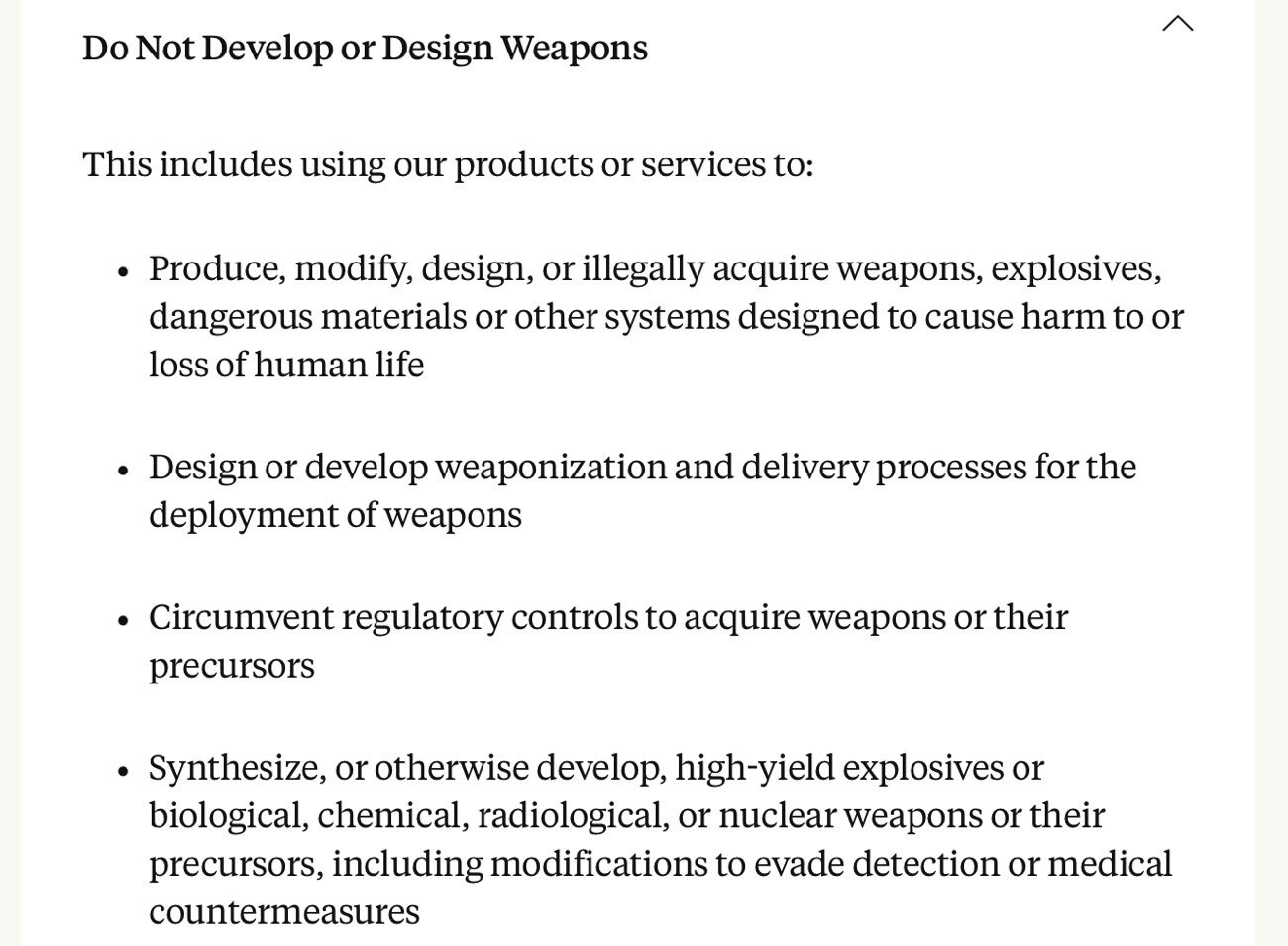

Créer, ou développer des explosifs de grande puissance, ou des armes biologiques, chimiques, radiologiques ou nucléaires ou leurs précurseurs, incluant leur modification pour échapper à la détection ou limiter les parades médicales à leur usage [est interdit].

Cette précision on ne peut plus claire fait partie d’une mise à jour du règlement d’utilisation de l’IA Claude, comme l’a repéré TheVerge. La comparaison entre l’ancien règlement d’utilisation et le nouveau est sans appel : quand Anthropic se contentait de résumer en parlant d’activité illégale de diffusion ou d’acquisition de substances contrôlées, ou de production et modification d’armes et autres explosifs, elle liste maintenant clairement ce qui fait partie de ce qu’on appelle communément le risque « NRBC » (pour Nucléaire, Radiologique, Bactériologique et Chimique).

L’entreprise insiste aussi particulièrement sur son refus que Claude soit utilisée à des fins de piratage et d’introduction dans des systèmes informatiques, dans un nouveau chapitre intitulé « Do Not Compromise Computer or Network Systems » (ne pas porter atteinte à des ordinateurs ou des serveurs). Ainsi, Anthropic interdit l’usage de son IA pour découvrir et exploiter des failles, créer ou distribuer des malwares, ou développer des outils d’attaque DDoS entre autres.

Bien entendu, ces règles ne sont pas que des paroles, et des brides ont été intégrées dans l’IA pour éviter qu’elle ne serve ces noirs desseins. Mais la technologie n’étant pas parfaite, Anthropic tout comme ses concurrents se protègent en spécifiant les usages pour lesquels elle proscrit l’utilisation de ses outils. Après tout, il serait dommage et très mal vu d’être responsable d’une catastrophe d’ampleur juste parce qu’un petit malin a voulu jouer avec l’IA : si un ado dans sa cabane de jardin a pu avoir l’idée folle de créer un réacteur nucléaire, qui sait ce que son descendant pourrait créer grâce à l’intelligence artificielle...